Cómo Crear un Sistema de RAG Multimodal Real que Busque en Texto, Imágenes, Vídeo y Audio

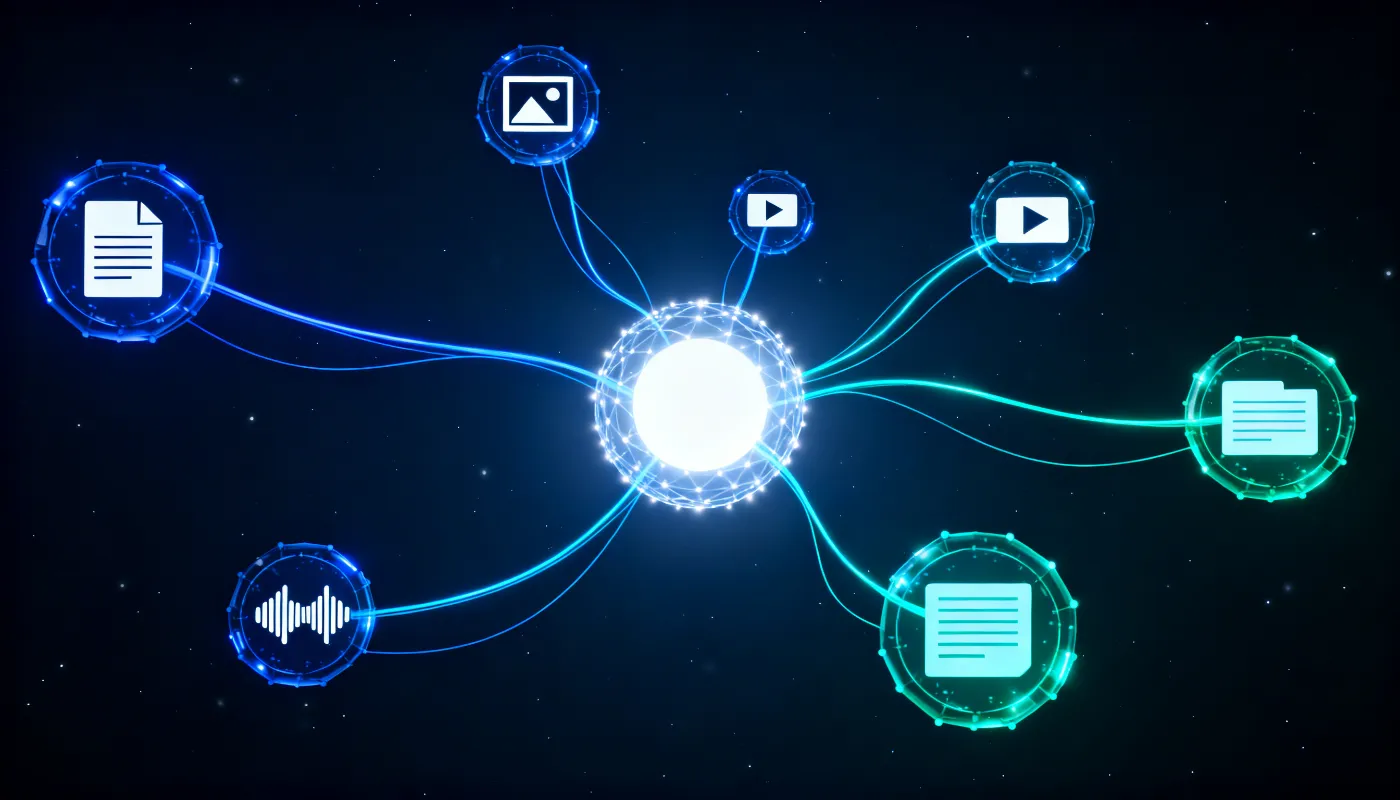

Google acaba de lanzar una revolución silenciosa en el mundo del procesamiento de información: Gemini Embedding 2, un modelo que soporta embeddings multimodales nativos. Esto significa que por primera vez puedes indexar textos, imágenes, vídeos, audio y documentos PDF en una única base de datos vectorial, creando lo que podríamos llamar un «cerebro semántico» para tu aplicación. El mercado de RAG crece a un ritmo del 49% anual y alcanzará los 10.000 millones de dólares en 2030. Si eres desarrollador o líder técnico y quieres estar a la vanguardia, este es tu artículo.

¿Qué es Gemini Embedding 2 y por qué es revolucionario?

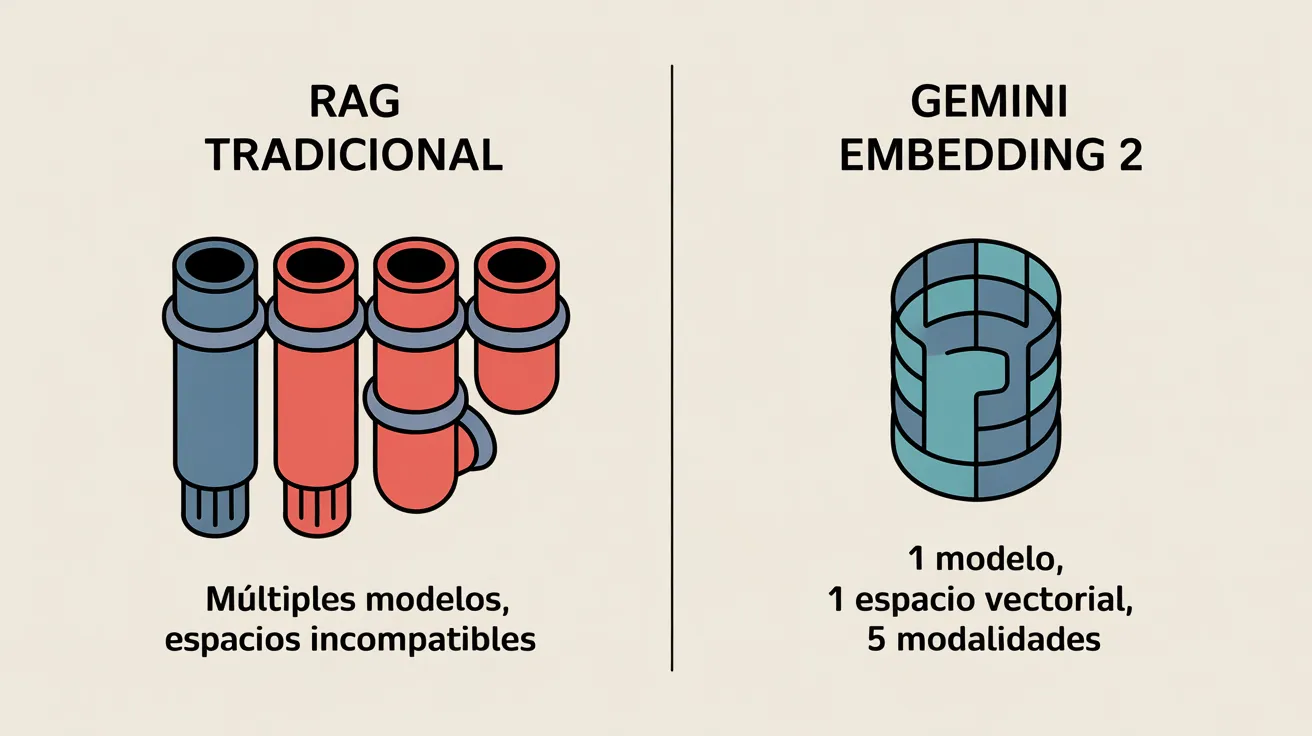

Un embedding es una representación numérica de un concepto o contenido. Tradicionalmente, los sistemas de IA podían procesar texto, imágenes o vídeos por separado, pero nunca de manera nativa en el mismo índice. Gemini Embedding 2, lanzado el 10 de marzo de 2026, cambia esto por completo al mapear cinco tipos de contenido en un único espacio vectorial de 3.072 dimensiones.

Características técnicas principales

- Soporte multimodal nativo: Texto, imágenes, vídeos (hasta 120s), audio y documentos PDF en el mismo índice.

- Matryoshka Representation Learning (MRL): Dimensiones flexibles (3.072, 1.536 o 768) para optimizar velocidad vs precisión.

- Ventana de contexto de 8.192 tokens: 4x más que modelos anteriores, ideal para chunks grandes en RAG.

- Líder en benchmarks: 68,32 en MTEB English (5 puntos por encima del segundo), 68,8 en video retrieval.

- Precio accesible: $0,20 por millón de tokens de texto, $0,10 en batch API.

De CLIP a Gemini: un salto arquitectónico

El enfoque tradicional para embeddings multimodales ha sido la familia CLIP: un encoder de visión para imágenes, un encoder de texto separado, y aprendizaje contrastivo para alinear ambos al final. Gemini Embedding 2 está construido directamente sobre la arquitectura Gemini, heredando su comprensión multimodal desde las capas intermedias del transformer. No son dos modelos alineados: es un único modelo que «piensa» en múltiples modalidades de forma nativa.

“Elegimos los embeddings de Gemini para ayudar a los profesionales legales a encontrar información crítica durante el proceso de descubrimiento en litigios, un desafío altamente técnico en un entorno de alto riesgo donde Gemini destaca.”

— Everlaw, plataforma de tecnología legal, partner de acceso anticipado de Gemini Embedding 2

¿Qué es RAG y por qué necesitas multimodalidad?

Retrieval Augmented Generation (RAG) es el patrón dominante en IA empresarial. En lugar de confiar únicamente en la memoria del modelo, RAG busca información relevante en bases de datos externas y la inyecta en el contexto antes de generar una respuesta. Esto reduce las alucinaciones hasta un 90% y permite que la IA trabaje con datos propios y actualizados.

El mercado RAG en números

| Métrica | Dato |

| Mercado RAG 2025 | $1,94 mil millones |

| Mercado RAG 2030 (proyección) | $9,86-11 mil millones |

| CAGR 2025-2030 | 38-49% según fuente |

| Fortune 500 con RAG piloto | 65% |

| Reducción de alucinaciones con RAG | 50-90% |

| ROI de GenAI con RAG (Microsoft) | $3,70 por cada $1 invertido |

Tutorial práctico: implementando RAG multimodal con Gemini Embedding 2

Esta guía te lleva desde cero hasta un sistema funcional. Si necesitas ayuda para definir la estrategia de IA de tu empresa, una consultoría de IA especializada puede acelerar el proceso.

Paso 1: Obtener API keys y configurar el entorno

Accede a Google AI Studio para obtener tu API key de Gemini (gratuita con límites). Instala la SDK de Python con pip install google-genai. Para la base de datos vectorial, Pinecone, Weaviate o ChromaDB son opciones sólidas. Crea un índice con dimensionalidad 3.072 y métrica de similitud coseno.

Paso 2: Generar embeddings multimodales

La magia está en la simplicidad. Con una sola llamada a la API, puedes generar embeddings de texto, imágenes, audio o vídeo. El modelo acepta hasta 6 imágenes por petición (PNG/JPEG), vídeos de hasta 120 segundos (MP4/MOV) y audio de hasta 80 segundos (MP3/WAV). La salida es siempre un vector de 3.072 dimensiones que vive en el mismo espacio semántico, independientemente del tipo de input.

Paso 3: Construir el pipeline de búsqueda cross-modal

Una vez indexado tu contenido, la búsqueda funciona en cualquier dirección: puedes escribir una consulta en texto y recuperar imágenes, vídeos o documentos relevantes. Puedes subir una foto y encontrar textos o vídeos relacionados. Esta flexibilidad elimina la necesidad de pipelines separados y abre casos de uso que antes eran imposibles sin equipos de ingeniería dedicados.

Casos de uso empresariales de RAG multimodal

Soporte empresarial inteligente

Imagina un chatbot de soporte que no solo busca en manuales de texto, sino también en vídeos tutoriales, imágenes de productos y grabaciones de llamadas anteriores. Para empresas que ya tienen automatizaciones empresariales con IA, añadir RAG multimodal transforma la experiencia del cliente.

E-commerce con búsqueda visual

Los clientes pueden buscar productos subiendo una foto en lugar de describir con palabras. Un chatbot IA para tiendas online con RAG multimodal puede mostrar productos similares instantáneamente, cruzando imágenes del catálogo con la consulta visual del usuario.

Descubrimiento legal y compliance

Everlaw, plataforma de tecnología legal, reporta una mejora del 20% en recall al buscar en documentos heterogéneos (PDFs, imágenes, correos). En litigios donde hay millones de registros, la capacidad de indexar imágenes y vídeos junto al texto permite encontrar evidencia crítica que antes se perdía entre silos de datos.

Comparativa: Gemini Embedding 2 vs la competencia

| Modelo | Multimodal | Dimensiones | Coste |

| Gemini Embedding 2 | Sí (nativo: 5 tipos) | 3.072 (MRL) | $0,20/M tokens |

| OpenAI text-embedding-3 | Solo texto | 3.072 | $0,13/M tokens |

| Voyage Multimodal 3.5 | Texto + Imágenes | 1.024 | $0,06/M tokens |

| Amazon Nova 2 | Texto + Imágenes + Vídeo | 1.024 | Pricing variable |

Consideraciones técnicas y mejores prácticas

- Recalibra umbrales de similitud: Cada modelo de embedding distribuye vectores de forma diferente. Los puntos de corte de similitud coseno de tu pipeline cambiarán al migrar. Haz A/B testing antes de cortar.

- Chunking inteligente para vídeo y audio: Vídeos de más de 120 segundos deben segmentarse. Usa cortes por escena o por intervalos fijos de 60s para mantener coherencia semántica.

- MRL para optimizar coste: Usa 768 dimensiones para búsqueda rápida inicial y 3.072 para re-ranking de precisión. Esto reduce el coste computacional sin sacrificar calidad final.

- Shadow index antes de migrar: Mantiene tu sistema actual en producción mientras re-indexas en paralelo con Gemini Embedding 2. Solo corta cuando los resultados A/B confirmen mejora.

Para PYMEs que quieren evaluar si están preparadas para implementar RAG, el checklist de adopción de IA para PYMEs es un punto de partida práctico. Y la evolución hacia sistemas multimodales es parte de lo que muchos llaman la nueva era de los agentes de IA.

Gemini Embedding 2 no es solo una mejora incremental. Es un cambio de paradigma: un único modelo que entiende texto, imágenes, vídeo, audio y documentos en el mismo espacio semántico. Para equipos que construyen RAG, esto elimina la complejidad de mantener pipelines separados y abre posibilidades que antes requerían meses de ingeniería. El futuro de la IA empresarial no es solo texto. Es la integración fluida de todos los medios en sistemas que pueden aprender, razonar y responder con una comprensión verdaderamente holística de la información. Las herramientas están listas. Es hora de construir.

Fuentes consultadas para este articulo:

- Google Blog – Gemini Embedding 2: Our first natively multimodal embedding model

- Google DeepMind – Gemini Embedding 2

- VentureBeat – Gemini Embedding 2 arrives with native multimodal support

- MarkTechPost – Google AI Introduces Gemini Embedding 2

- Medium / Ewan Mak – Gemini Embedding 2: Specs, Benchmarks, Pricing

- Medium / Karl Weinmeister – What you need to know about Gemini Embedding 2

- Towards Data Science – Introducing Gemini Embeddings 2 Preview

- BuildFastWithAI – Gemini Embedding 2: First Multimodal Embedding Model

- AdwaitX – Gemini Embedding 2 Launches: First Multimodal AI Model

- Google Cloud Docs – Gemini Embedding 2 on Vertex AI

- Grand View Research – RAG Market Size Report 2030

- MarketsandMarkets – RAG Market worth $9.86 billion by 2030

- Precedence Research – RAG Market Size 2025 to 2034

- Squirro – RAG in 2026: Bridging Knowledge and Generative AI

- Vectara – Enterprise RAG Predictions

- WiFi Talents – RAG Industry Statistics 2026

- Mordor Intelligence – RAG Market Size & Growth Trends

- Next Move Strategy – RAG Market Outlook 2035

- Pinecone – What is RAG? (Retrieval Augmented Generation)

- LangChain – RAG Tutorial with Gemini